Meranie štrukturálnych parametrov kapsúl použitím techník umelej inteligencie (AI) a strojového učenia (ML)

Cieľom spolupráce medzi Národným kompetenčným centrom pre HPC (NCC pre HPC) a Ústavom polymérov (ÚP) SAV bol návrh a implementácia pilotného softvérového riešenia pre automatické spracovanie obrazu frakcií polymérnych mikrokapsúl. Tieto mikrokapsuly slúžia ako obal pre pankreatické ostrovčeky tvoriace perspektívne liečivo na ochorenie diabetes mellitus (t.j. cukrovky 1. typu). Mikrokapsuly pozostávajú z pankreatických ostrovčekov enkapsulovaných do polopriepustnej polymérnej membrány, ktorá bola vyvinutá na Ústave polymérov SAV.

Automatizované riešenie je pre ÚP SAV mimoriadne dôležité z hľadiska časovej úspory a zjednodušenia vyhodnocovania početných výstupov z meraní, ako aj minimalizácie chyby, ktorá sa môže objaviť pri manuálnom spracovaní. Obrázky z optického mikroskopu pri 4-násobnom zväčšení typicky obsahujú jednu alebo niekoľko mikrokapsúl a sú vstupom do tréningu AI/ML modelov. Obrázky z optického mikroskopu pri 2,5-násobnom zväčšení obsahujú viac mikrokapsúl, zvyčajne tri až sedem. V takomto prípade je nutné v prvom kroku identifikovať jednotlivé mikrokapsuly. V procese inferencie sa z príslušného obrázku vytvorí tzv. binárna maska, z ktorej sa následne extrahujú informácie o štrukturálnych parametroch, akými sú predovšetkým vnútorný a vonkajší priemer kapsuly a hrúbka jej membrány.

Obrazový materiál je spracovaný v dvoch krokoch. Prvým krokom je lokalizácia nedefektných kapsúl a ich následné vystrihnutie, druhým je séria operácií vedúcich k samotnému určeniu štrukturálnych parametrov.

DETEKCIA KAPSÚL

Na detekciu kapsúl bol použitý model YOLOv5 [1] s predtrénovanými váhami z databázy COCO128 [2]. Tréningové dáta pozostávali z 96 snímok, ktoré boli manuálne anotované pomocou nástroja LabelImg [3]. Tréningová jednotka pozostávala z 300 epoch, snímky boli rozdelené do sád po 16 a ich veľkosť bola nastavená na 640 pixelov. Výpočtový čas jednej tréningovej jednotky na grafickej karte NVIDIA GeForce GTX 1650 bol približne 3.5 hodiny.

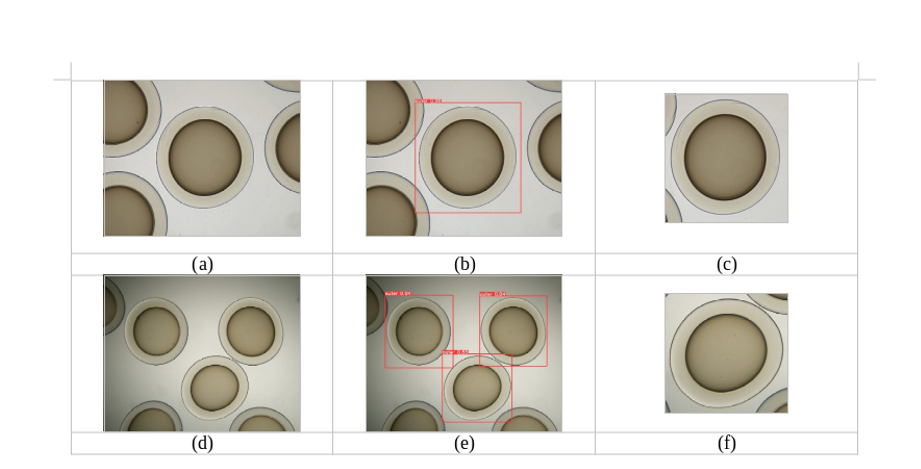

Detekcia pomocou natrénovaného YOLOv5 modelu je prezentovaná na Obrázku 1. Spoľahlivosť natrénovaného modelu, overená na 12 snímkach, bola 96%, pričom priepustnosť na rovnakej grafickej karte bola približne 40 snímok za sekundu.

MERANIE ŠTRUKTURALNÝCH PARAMETROV KAPSÚL POMOCOU TECHNÍK AI/ML

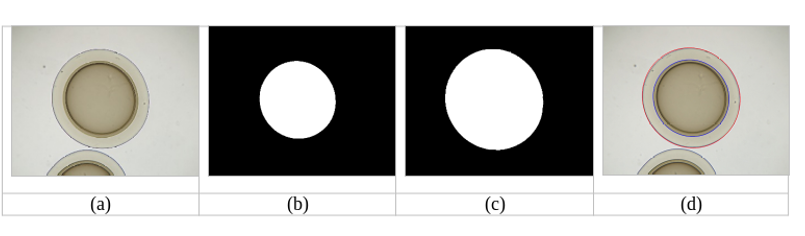

Binárne masky pre vnútorné a vonkajšie časti kapsúl boli získané individuálne, ako výstup z hlbokej neurónovej siete architektúry U-Net [4], ktorá bola vyvinutá na spracovanie obrazu v biomedicínskych aplikáciách. Na tréning príslušných váh bolo použitých 140 obrázkov s korešpondujúcimi maskami pre 4-násobné zväčšenie optického mikroskopu a rovnako 140 obrázkov s korešpondujúcimi maskami aj pre 2,5-násobné zväčšenie. Tréningový proces pozostával z 200 epoch (veľkosť sady 16), pričom 10% z tréningových dát bolo použitých na validáciu. Presnosť na testovacej sade, ktorá pozostávala zo 120 obrázkov, presahovala 96%. Tréningový proces trval 1,5 až 2 hodiny a na trénovanie bol využitý HPC systém s uzlami typu IBM Power 7. Tento proces bolo nutné niekoľkokrát opakovať. Výstupné binárne masky boli následne postprocesované operáciami „fill_holes” [5] a „watershed“ [6], na získanie čo najhladších oválnych masiek. Následne bola na masky fitovaná elipsa s využitím knižnice „scikit-image measure“ [7], ktorej hlavná a vedľajšia os sú základom pre samotný výpočet štrukturálnych parametrov. Postupnosť týchto krokov je prezentovaná na Obrázku 2.

Štrukturálne parametre získané predikciou AI/ML modelu (značený ďalej ako „U-Net“) boli porovnané s hodnotami, ktorými disponovali pracovníci ÚP SAV a boli získané „manuálnym meraním“ v snímkach. Ako ďalší, nezávislý zdroj referenčných dát bol použitý prístup označovaný ďalej ako „Retinex“, ktorý navrhol a implementoval RNDR. Andrej Lúčny, PhD. z Katedry aplikovanej informatiky Fakulty matematiky, fyziky a informatiky Univerzity Komenského v Bratislave. Tento prístup nevyužíva neurónové siete, ale vytvára kandidátov na binárne masky agregáciou úsekov s nízkou krivosťou, získaných pomocou „retinex“ filtra [8] tak, aby vytvorili útvar s minimálnou štandardnou odchýlkou krivosti. Tento prístup je dobrou referenciou, nakoľko nevyžaduje trénovanie a je vysoko presný, avšak na rozdiel od modelu U-net nie je plne automatizovaný, obzvlášť pre vnútornú membránu kapsuly.

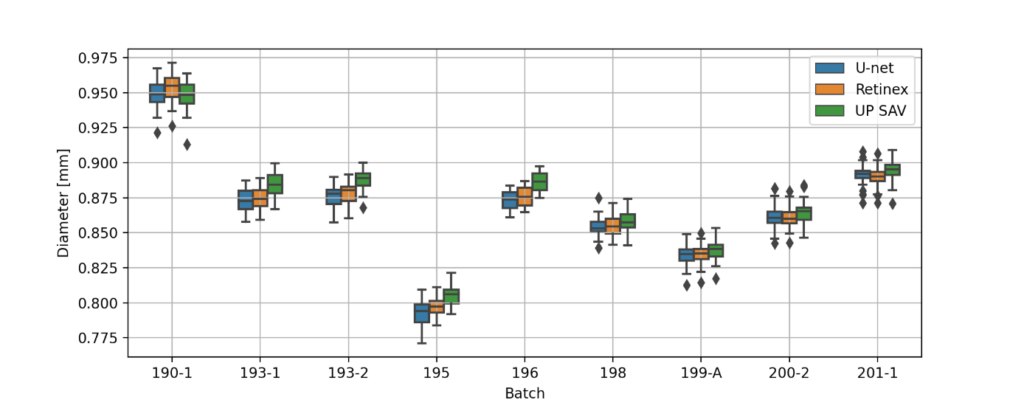

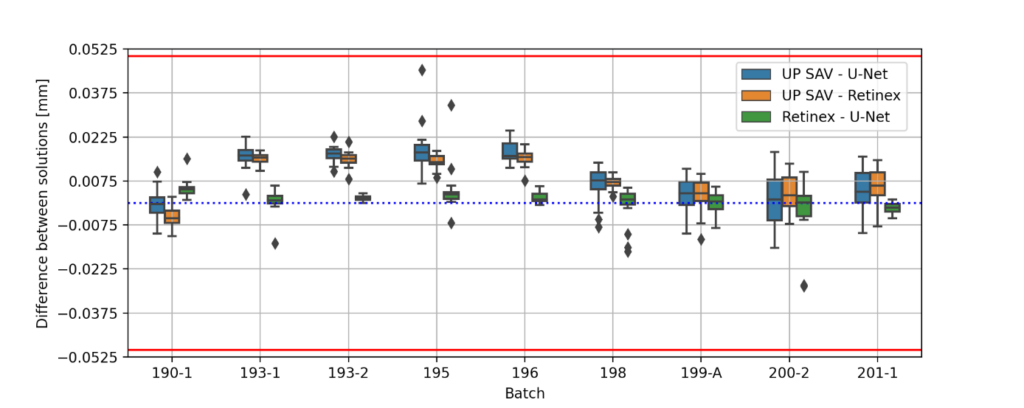

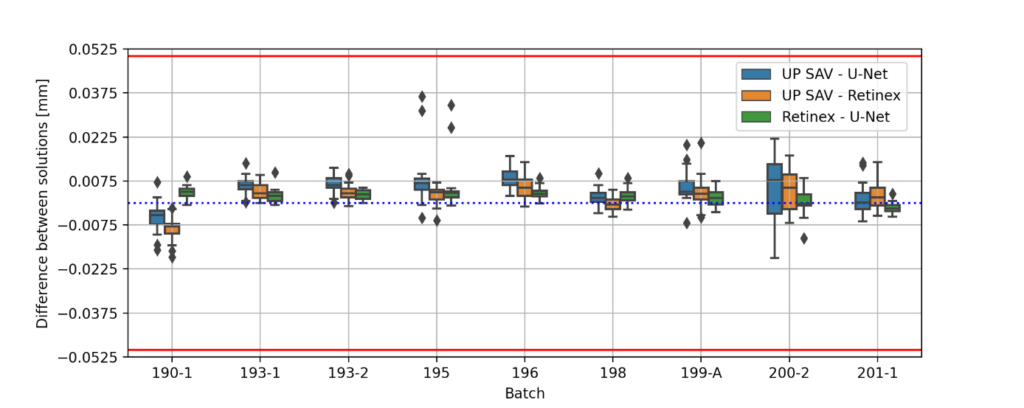

Obrázok 3 sumarizuje porovnanie všetkých spomenutých riešení pre rôzne sady („batches“) z experimentov pre obrázky získané pri 4-násobnom zväčšení.

Obrázok 3: (a) rozmer kapsúl vypočítaný pre prístupy U-net a Retinex ako priemer hlavnej a vedľajšej osi elipsy (b) rozdiel medzi hlavnou osou elipsy pre vonkajší priemer kapsúl (c) rozdiel medzi vedľajšou osou elipsy pre vonkajší priemer kapsúl. V obrázkoch (b) a (c) je červenou čiarou zobrazená hraničná odchýlka akceptovateľná ÚP SAV. Obrázky z optického mikroskopu boli získané pri 4-násobnom zväčšení.

Zo získaných výsledkov je možné skonštatovať, že až na 4 snímky (1.5%) v sade 194 pre vedľajšiu os elipsy, sú všetky parametre v medziach akceptovateľnej presnosti, ktorá bola definovaná ÚP SAV. Z Obrázku 3(a) pozorujeme systematicky lepšiu vzájomnú zhodu medzi výsledkami získanými prístupmi U-net a Retinex, čo môže byť spôsobené buď aproximáciou tvaru kapsuly elipsou, ktorá sa v „manuálnom vyhodnotení“ ÚP SAV neaplikovala, alebo iným, systematickým rozdielom pri vyhodnocovaní, a/alebo chybou v „manuálnom vyhodnotení“. Kvalita U-net modelu môže byť do budúcna výrazne zlepšená, hlavne rozšírením tréningovej sady ako aj aplikovaním ďalšieho pre- a postprocesingu. Zhoda medzi „manuálnym vyhodnotením“ a modelmi U-net / Retinex môže byť zlepšená harmonizáciou spôsobu vyhodnocovania štrukturálnych parametrov kapsúl z binárnych masiek.

AI/ML model bude nasadený v predprodukčnej fáze ako cloudové riešenie na HPC systémoch CSČ SAV. Inferencia a kontinuálny tréning s pribúdajúcimi snímkami nebude vyžadovať investíciu do vysokovýkonných výpočtových prostriedkov samotným ÚP SAV. Produkčná fáza, ktorá presahuje rámec pilotného riešenia, uvažuje s integráciou tohto prístupu do desktopovej aplikácie.

Zdroje:

[1] https://github.com/ultralytics/yolov5

[2] https://www.kaggle.com/ultralytics/coco128

[3] https://github.com/heartexlabs/labelImg

[4] https://lmb.informatik.uni-freiburg.de/people/ronneber/u-net/

[5] https://docs.scipy.org/doc/scipy/reference/generated/scipy.ndimage.binary_fill_holes.html

[6] https://scikit-image.org/docs/stable/auto_examples/segmentation/plot_watershed.html

[7] https://scikit-image.org/docs/stable/api/skimage.measure.html

[8] D.J. Jobson, Z. Rahman, G.A. Woodell, IEEE Transactions on Image Processing 6 (7) 965-976, 1997.

Umelá inteligencia a superpočítač ako nová zbraň proti ekologickým haváriám 26 mar - Slovenskí vedci z Nitry učia stroje predvídať poruchy v priemysle skôr, než stihnú napáchať škody. Vďaka spolupráci s európskym superpočítačom LUMI vyvinuli digitálneho „strážcu“, ktorý dokáže s vysokou presnosťou odhaliť úniky v potrubiach alebo chyby vo výrobe, čím chráni našu prírodu aj peňaženky podnikov.

Umelá inteligencia a superpočítač ako nová zbraň proti ekologickým haváriám 26 mar - Slovenskí vedci z Nitry učia stroje predvídať poruchy v priemysle skôr, než stihnú napáchať škody. Vďaka spolupráci s európskym superpočítačom LUMI vyvinuli digitálneho „strážcu“, ktorý dokáže s vysokou presnosťou odhaliť úniky v potrubiach alebo chyby vo výrobe, čím chráni našu prírodu aj peňaženky podnikov. Slovenský recept na férové hry a spokojnejších hráčov 25 mar - Hráte sa na mobile a máte pocit, že vám hra nerozumie? Slovenskí experti z Nitry využili jeden z najvýkonnejších superpočítačov v Európe, aby to zmenili. Vďaka talianskemu obrovi menom Leonardo prišli na to, ako čítať medzi riadkami hráčskeho správania a urobiť herný zážitok osobnejším a férovejším.

Slovenský recept na férové hry a spokojnejších hráčov 25 mar - Hráte sa na mobile a máte pocit, že vám hra nerozumie? Slovenskí experti z Nitry využili jeden z najvýkonnejších superpočítačov v Európe, aby to zmenili. Vďaka talianskemu obrovi menom Leonardo prišli na to, ako čítať medzi riadkami hráčskeho správania a urobiť herný zážitok osobnejším a férovejším. Mestské budovy sa prebúdzajú: Slovenská AI dáva druhú šancu nevyužitým priestorom 4 mar - Mestá sú živé organizmy, ktoré sa neustále menia. Mnohí z nás však v susedstve denne míňajú tiché svedectvá minulosti – prázdne školy, nevyužívané úrady či chátrajúce verejné budovy. Často si kladieme otázky: „Prečo je to zatvorené?“ „Nemohol by tu byť radšej denný stacionár, škôlka alebo kultúrne centrum?“

Mestské budovy sa prebúdzajú: Slovenská AI dáva druhú šancu nevyužitým priestorom 4 mar - Mestá sú živé organizmy, ktoré sa neustále menia. Mnohí z nás však v susedstve denne míňajú tiché svedectvá minulosti – prázdne školy, nevyužívané úrady či chátrajúce verejné budovy. Často si kladieme otázky: „Prečo je to zatvorené?“ „Nemohol by tu byť radšej denný stacionár, škôlka alebo kultúrne centrum?“