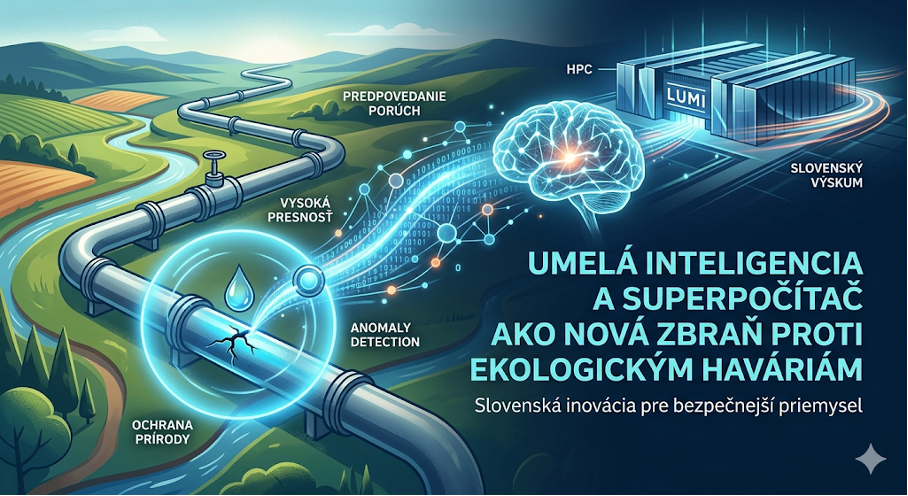

Umelá inteligencia a superpočítač ako nová zbraň proti ekologickým haváriám

Slovenskí vedci z Nitry učia stroje predvídať poruchy v priemysle skôr, než stihnú napáchať škody. Vďaka spolupráci s európskym superpočítačom LUMI vyvinuli digitálneho „strážcu“, ktorý dokáže s vysokou presnosťou odhaliť úniky v potrubiach alebo chyby vo výrobe, čím chráni našu prírodu aj peňaženky podnikov.

Výzva

Moderné továrne a stovky kilometrov potrubí, ktoré križujú našu krajinu, sú doslova prešpikované senzormi. Tie nepretržite chrlia tisíce údajov o tlaku, teplote či vibráciách. Problémom je, že týchto informácií je také obrovské množstvo a sú také zložité, že ich bežné počítače nedokážu efektívne spracovať. Často sa tak stáva, že dôležité varovné signály o blížiacej sa poruche zostanú nepovšimnuté, až kým nie je neskoro.

Riešenie

Tím odborníkov z Fakulty prírodných vied a informatiky UKF v Nitre sa rozhodol tento problém vyriešiť pomocou umelej inteligencie (AI).Ich cieľom bolo vytvoriť inteligentné modely, ktoré fungujú ako skúsený revízny technik, až na to, že dokážu sledovať tisíce parametrov naraz a v reálnom čase.

Aby tento „digitálny mozog“ vytrénovali, potrebovali obrovský výkon. Ten našli v superpočítači LUMI, jednom z najvýkonnejších systémov na svete. Na tomto digitálnom obrovi testovali tisíce rôznych scenárov a kombinácií, aby našli ten najpresnejší spôsob, ako odhaliť aj ten najmenší únik v potrubí.

Prínos

Využitie superpočítača prinieslo výsledky, ktoré by boli na bežnom kancelárskom PC nedosiahnuteľné:

- Neuveriteľná rýchlosť: To, čo by bežnému počítaču trvalo celé mesiace až roky, zvládol superpočítač vďaka svojej „surovej sile“ za pár týždňov.

- Presnosť nadovšetko: Vedci mieria na viac ako 92-percentnú úspešnosť pri odhaľovaní porúch priamo v teréne, čím chcú prekonať aj tradičné fyzikálne výpočty.

- Záchranná sieť pre prírodu: Včasná detekcia úniku ropy či iných látok znamená, že sa k havárii dostanú technici skôr, než stihne kontaminovať pôdu alebo vodu.

- Slovenské riešenie pre Európu: Vyvinuté postupy už teraz pomáhajú súkromným firmám a iným vedcom v strednej Európe pri modernizácii ich prevádzok.

Pohľad do budúcna

Týmto úspechom sa práca nekončí. Nitriansky tím plánuje svoje modely ďalej zdokonaľovať a nasadiť ich do ostrej prevádzky vo forme inteligentných aplikácií. Tie budú v budúcnosti strážiť nielen priemyselné potrubia, ale aj efektivitu výroby, aby bola zelenšia, bezpečnejšia a konkurencieschopnejšia.

Najväčším prínosom pre vedcov bola obrovská sila systému, vďaka ktorej nenarazili na žiadne limity. Spolu s rýchlou technickou podporou sa mohli naplno sústrediť na to podstatné – ako urobiť priemysel inteligentnejším.

Umelá inteligencia a superpočítač ako nová zbraň proti ekologickým haváriám 26 mar - Slovenskí vedci z Nitry učia stroje predvídať poruchy v priemysle skôr, než stihnú napáchať škody. Vďaka spolupráci s európskym superpočítačom LUMI vyvinuli digitálneho „strážcu“, ktorý dokáže s vysokou presnosťou odhaliť úniky v potrubiach alebo chyby vo výrobe, čím chráni našu prírodu aj peňaženky podnikov.

Umelá inteligencia a superpočítač ako nová zbraň proti ekologickým haváriám 26 mar - Slovenskí vedci z Nitry učia stroje predvídať poruchy v priemysle skôr, než stihnú napáchať škody. Vďaka spolupráci s európskym superpočítačom LUMI vyvinuli digitálneho „strážcu“, ktorý dokáže s vysokou presnosťou odhaliť úniky v potrubiach alebo chyby vo výrobe, čím chráni našu prírodu aj peňaženky podnikov. Slovenský recept na férové hry a spokojnejších hráčov 25 mar - Hráte sa na mobile a máte pocit, že vám hra nerozumie? Slovenskí experti z Nitry využili jeden z najvýkonnejších superpočítačov v Európe, aby to zmenili. Vďaka talianskemu obrovi menom Leonardo prišli na to, ako čítať medzi riadkami hráčskeho správania a urobiť herný zážitok osobnejším a férovejším.

Slovenský recept na férové hry a spokojnejších hráčov 25 mar - Hráte sa na mobile a máte pocit, že vám hra nerozumie? Slovenskí experti z Nitry využili jeden z najvýkonnejších superpočítačov v Európe, aby to zmenili. Vďaka talianskemu obrovi menom Leonardo prišli na to, ako čítať medzi riadkami hráčskeho správania a urobiť herný zážitok osobnejším a férovejším. Prihláste sa na letnú školu EUMaster4HPC 2026 zameranú na vysokovýkonné počítanie 23 mar - V dňoch 5. – 14. júla 2026 sa v Luxembursku uskutoční letná škola EUMaster4HPC s názvom High-Performance Computing and Emerging Trends. Podujatie bude prebiehať v priestoroch Marienthal Youth Center a University of Luxembourg v Belvale.

Prihláste sa na letnú školu EUMaster4HPC 2026 zameranú na vysokovýkonné počítanie 23 mar - V dňoch 5. – 14. júla 2026 sa v Luxembursku uskutoční letná škola EUMaster4HPC s názvom High-Performance Computing and Emerging Trends. Podujatie bude prebiehať v priestoroch Marienthal Youth Center a University of Luxembourg v Belvale.